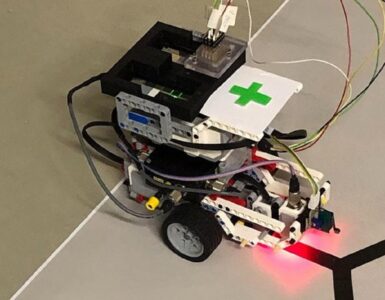

Científicos del Instituto Fraunhofer de Telecomunicaciones, Heinrich-Hertz-Institut, (HHI de Berlín, han desarrollado un sistema que permite manejar el ordenador sólo con los gestos de las manos, según informa dicho Instituto.

Bautizado como iPoint Presenter, este dispositivo posibilita una interacción entre humano-ordenador muy similar a la de la película “Minority Report”, de Steven Spielberg, en la que Tom Cruise movía y seleccionaba información en pantallas informáticas simplemente con el movimiento de sus manos.

El sistema, una unidad móvil de control, detecta y rastrea los dedos de la mano de los usuarios sin necesidad de que haya ningún contacto de éstos con la máquina. Así, se pueden rotar, agrandar, arrastrar y presionar botones con simples gestos de los dedos.

Este innovador concepto de HCI (Interacción persona-ordenador o Human Computer Interaction) puede ser utilizado de manera sencilla con múltiples aplicaciones, como sistemas interactivos de información, visionado de imágenes, juegos o herramientas geográficas como el Google Earth, señala el HHI.

Señalar para pulsar

Según un comunicado del Fraunhofer Heinrich-Hertz-Institut, el núcleo del sistema está formado por un conjunto de cámaras que permite al ordenador “observar” a la persona situada frente a la pantalla. Cuando esa persona mueve sus manos, el ordenador reacciona a partir de la “lectura” de la posición del dedo índice del usuario, y siguiendo sus movimientos.

Por ejemplo, el usuario puede señalar a determinados botones para que sean “pulsados” o realizar gestos para mover los objetos virtuales que aparecen en pantalla. A través de la “multipointing interaction” o interacción multi-señalamiento se pueden utilizar diversos dedos para rotar, alargar o minimizar objetos.

Todas estas acciones no requieren guantes especiales y tienen un sencillo uso “intuitivo”, es decir, no requieren de una preparación previa.

El iPoint Presenter ha sido presentado en la feria CeBIT 2008, celebrada en Hánover, Alemania, entre el cuatro y el nueve de marzo. Esta feria, la más importante del mundo en el sector, sirve para exponer ordenadores, tecnologías de la información, telecomunicaciones, programas y servicios novedosos, y está considerada como el barómetro anual del estado de las tecnologías de la información.

Allí, iPoint Presenter fue mostrado en las aplicaciones de un juego interactivo y de un visualizador de imágenes. Pero podría servir además, por ejemplo, para sustituir las pantallas táctiles en terminales de información o para ayudar a editar y organizar fotografías.

Zapping sin mando

Otras aplicaciones, según sus creadores, serían las presentaciones de cualquier información ante un público –sin necesidad de utilizar un ratón o un señalador láser-, en las que el usuario podría resaltar la información más importante sólo señalándola con el dedo.

Por otro lado, el dispositivo puede operar con hasta nueve cámaras para registrar los movimientos humanos, lo que incrementaría la capacidad operativa del usuario y permitiría manejar pantallas muy grandes, por ejemplo en ferias de negocio o presentaciones de publicidad.

Los conductores, por ejemplo, podrían controlar la radio del coche o los navegadores con mayor facilidad, y los televidentes desde sus sillones dejarían de necesitar un mando a distancia para hacer zapping. Las personas discapacitadas podrían también utilizar el sistema para interactuar con el ordenador sin necesidad de un ratón o un teclado.

Podría incluso crearse toda una nueva generación de video juegos si esta tecnología llegara a identificar e interpretar completamente los gestos humanos. En eso trabajan ahora investigadores del Fraunhofer Institute for Digital Media Technology IDMT, en la ciudad de Ilmenau, que intentan “enseñar” a los ordenadores a comprender los gestos humanos, y trabajan en el desarrollo de un método informático de reconocimiento automático de las diversas señales manuales.

La técnica imitaría la manera en que los humanos vemos las cosas: desde el momento en que los fotones (partículas de la luz) alcanzan la retina hasta el estadio en que la información visual es procesada por la corteza visual del cerebro humano. Los investigadores tratan de crear la simulación informática de todo este proceso.

Control e identificación

Sin duda esta noticia nos recuerda a otras noticias también recientes relacionadas con la capacidad de controlar a distancia dispositivos informáticos y con el desarrollo de programas informáticos de reconocimiento de caracteres humanos físicos.

Por un lado, la compañía Emotiv Systems presentó recientemente el primer dispositivo que permite el control de un ordenador sólo con la mente y el pensamiento, en este caso para aplicaciones muy específicas: los video juegos. Por un precio de tan sólo 200 euros, este sistema se encarga de descodificar las señales neuronales y transformarlas en acciones dentro de la pantalla.

Por otro lado, dos investigaciones también recientes han permitido avanzar en el desarrollo de algoritmos punteros en el reconocimiento facial por parte de ordenadores.

Se trata de los trabajos del informático Hung-Son Le, de la Universidad de Umea, en Suecia, que han culminado en la creación de un software que permite al ordenador la posibilidad de reconocer un rostro a partir de una única imagen; y de la labor de investigadores del Departamento de Inteligencia Artificial (DIA) de la Facultad de Informática de la Universidad Politécnica de Madrid (FIUPM), en colaboración con la Universidad Rey Juan Carlos de Madrid, que ha dado lugar al desarrollo de un algoritmo capaz de reconocer expresiones faciales en tiempo real (procesando 30 imágenes por segundo).

Hacer un comentario